IA y la era en que las imágenes ya no son garantía de la verdad

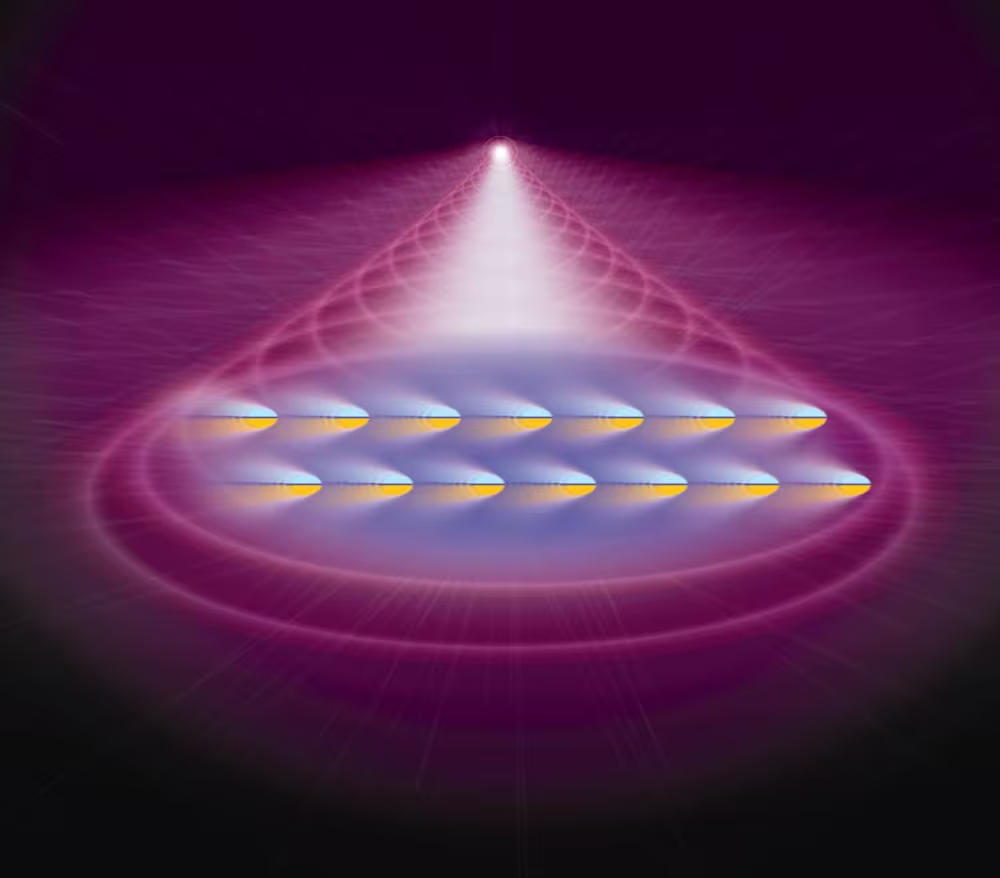

La IA generativa avanza a tal velocidad que ya puede producir imágenes casi indistinguibles de las reales, poniendo en jaque la noción de autenticidad visual y cuestionando la idea de que ver es creer.

asta hace no mucho tiempo, era bastante fácil reconocer las imágenes generadas por IA. Una serie de errores frecuentes delataban su origen sintético, como manos con seis dedos (o más), proporciones corporales insólitas y fondos incoherentes más cercanos al surrealismo que a la fotografía, poniendo en evidencia las limitaciones de la tecnología. Un vistazo rápido alcanzaba para descubrir, entre gestos y miradas inexpresivas, texturas y objetos imposibles, revelando sin lugar a dudas que aquello no había pasado por el lente de una cámara.

Hoy, esas imperfecciones casi desaparecieron por completo. Ahora, la tecnología de IA generativa no solo reproduce con precisión el relieve de la piel y la dirección de la luz, sino que los escenarios muestran un nivel de detalle superlativo, los gestos transmiten emociones creíbles y las miradas encuentran una profundidad humana que desarma cualquier sospecha. Incluso defectos, como arrugas sutiles o imperfecciones en el maquillaje, se integran de una forma tan natural que no hacen más que reforzar la ilusión de realidad.

La edición de julio de la revista Vogue puso a prueba este nuevo realismo al incluir, por primera vez entre sus páginas, un anuncio de Guess protagonizado por Vivienne, una modelo rubia, de curvas pronunciadas y rasgos impecables creada íntegramente mediante inteligencia artificial. En la doble página impresa, luce distintos conjuntos y posa en escenarios que bien podrían pasar por una producción fotográfica real, aunque su naturaleza sintética se daba a conocer únicamente en una discreta nota al pie dentro de la publicidad: “Producido por Seraphinne Vallora en IA”. Aun así, muchos lectores nunca advirtieron que no se trataba de una persona de carne y hueso.

La campaña de Guess desató una intensa polémica con varias aristas. Por un lado, reemplazar modelos reales por avatares digitales encendió las alarmas en la industria de la moda sobre la pérdida de oportunidades laborales. Directores de arte, fotógrafos y maquilladores ven amenazada la cadena de oficios que rodea una producción tradicional, donde cada profesional aporta su experiencia para dar vida a la imagen final. Por el otro, el aspecto hiperidealizado y perfectamente proporcionado de estas modelos virtuales fue duramente criticado por reforzar estereotipos de belleza ya no solo difíciles de alcanzar, una constante histórica en la industria de la moda. Ahora son, directamente, irreales.

Hay dos razones de peso para elegir modelos sintéticas antes que las reales: economía y eficiencia. Una campaña creada con inteligencia artificial puede costar hasta un 90% menos y generar, en segundos, la escena perfecta desde una computadora. Un mismo algoritmo es capaz de producir una infinidad de fotos en diferentes escenarios y poses, partiendo únicamente de unas prendas fotografiadas sobre un maniquí y aplicadas luego a una modelo virtual fotorrealista. Estos avatares “trabajan” las 24 horas del día, los siete días de la semana, sin cansarse, sin quejarse y, sobre todo, sin cobrar.

La controversia desatada por Vogue marca un punto de quiebre. Llegamos al momento en que lo capturado por una cámara y lo creado por un algoritmo se volvió tan difuso que, para la vista no entrenada, la diferencia prácticamente desapareció. Y las estadísticas lo confirman. Un estudio de Microsoft AI for Good Lab, una unidad de investigación del gigante tecnológico dedicada a la aplicación de IA en proyectos con impacto social y al análisis de sus efectos, concluyó que la capacidad humana para distinguir entre fotografías reales e imágenes generadas por IA apenas alcanza un 62 % de aciertos. En otras palabras, erramos casi cuatro de cada diez veces.

El experimento no sucedió entre las paredes impersonales de un laboratorio científico, sino en forma de Real or Not, un juego online en el que los participantes debían decidir, en pocos segundos y sin pistas adicionales, si la imagen que veían era una fotografía real o había sido creada por IA. Con más de 12.500 participantes y cerca de 287.000 evaluaciones, la prueba reveló que los errores de detección más comunes se dan en paisajes naturales y urbanos, mientras que los rostros humanos resultan más fáciles de identificar correctamente.

No se trata de un riesgo hipotético. La misma confusión que el experimento de Microsoft puso en evidencia ya está provocando conflictos reales, como un caso que sucedió a principios de este año entre una turista londinense y el propietario de un departamento de alquiler temporal en Manhattan, reservado a través de Airbnb. Poco después de su partida, tras varias semanas de estadía, la huésped fue acusada de provocar destrozos por más de 16.000 dólares. En la lista figuraban colchones manchados, una mesa de madera agrietada y varios electrodomésticos dañados, entre ellos una aspiradora robot, un televisor, un microondas y el aire acondicionado.

Las pruebas parecían contundentes. El anfitrión presentó fotos que documentaban roturas y desperfectos que fueron “analizadas cuidadosamente” por Airbnb, y falló a favor del propietario del departamento, solicitando a la clienta que reembolsara unos 7.000 dólares para cubrir los daños. Sin embargo, la mujer negó el reclamo, y como parte de su defensa señaló que en las fotos de la supuesta mesa dañada, la grieta aparecía diferente en cada imagen, lo que la llevó a sospechar que las fotos fueron manipuladas digitalmente, probablemente con IA. Finalmente, tras la apelación de la huésped y la intervención de la prensa, Airbnb admitió que no pudo verificar la autenticidad de las imágenes presentadas por el dueño del alojamiento y devolvió a la clienta el costo total de su estadía.

El caso de la turista inglesa es apenas la punta del iceberg de un fenómeno que crece aceleradamente. Las aseguradoras ya detectan un aumento considerable en reclamos fraudulentos respaldados con fotos y videos generados o editados con inteligencia artificial. Swiss Re, una de las empresas de reaseguros más grandes del mundo (es decir, la que asegura a las compañías de seguros) documentó una cantidad cada vez mayor de casos en los que se simulan accidentes de auto o incendios de vivienda con un realismo capaz de engañar a los peritos más experimentados, mientras que en el Reino Unido, Allianz y Zurich UK advirtieron un incremento del 300% en este tipo de denuncias falsas. Para hacerle frente a esta tendencia, las aseguradoras comenzaron a incorporar herramientas forenses basadas en IA para identificar indicios de manipulación antes de aprobar un pago.

Durante más de un siglo, la fotografía fue sinónimo de evidencia irrefutable, y hasta hace muy poco una imagen servía para probar lo que las palabras podían exagerar o distorsionar. Hoy, esa confianza se derrumba, y a medida que la IA se vuelve capaz de crear realidades alternativas cada vez más convincentes y personalizadas, nos obliga a recalibrar por completo nuestra relación con lo que vemos. Llegamos al final abrupto de la era de la “prueba fotográfica” para entrar, directo y sin escalas, en la era de la sospecha perpetua.

Fuente: Rosario3