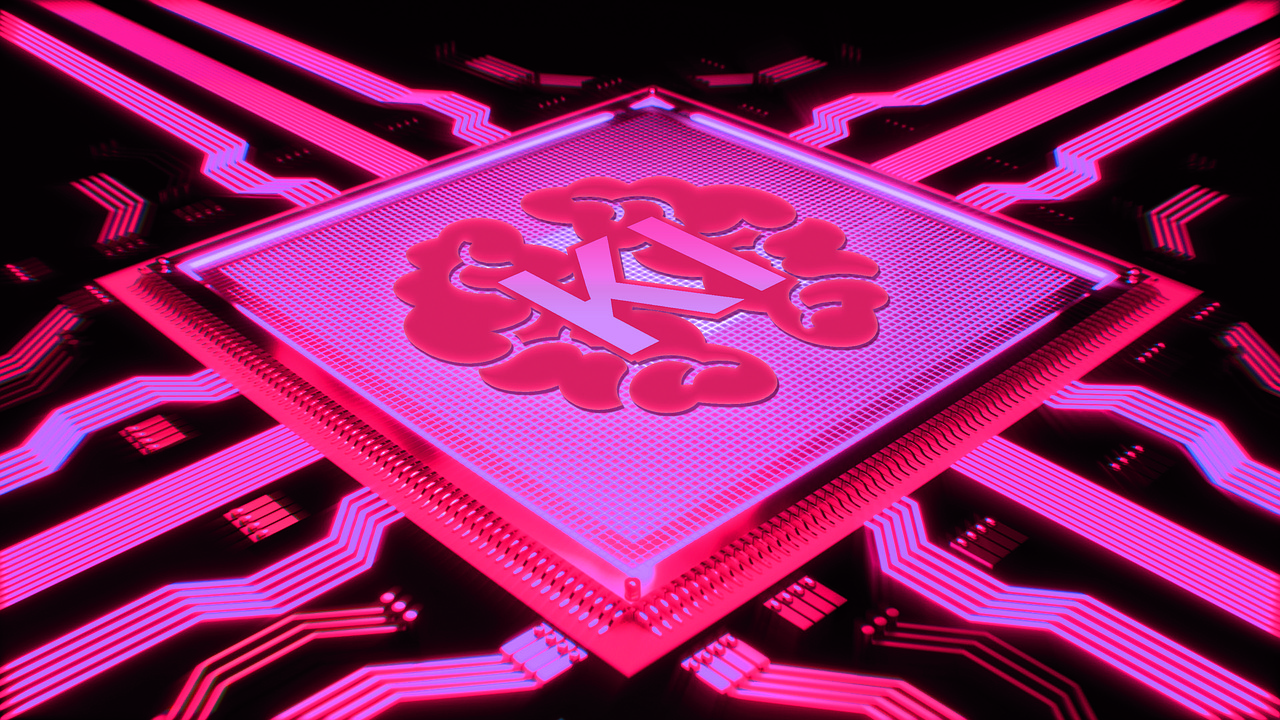

¿Puede ChatGPT afectar nuestras funciones cognitivas?

Un estudio preliminar del Instituto Tecnológico de Massachusetts advierte que el uso excesivo de herramientas como ChatGPT para tareas de escritura podría reducir la conectividad cerebral hasta en un 55%.

Más conformistas, desvinculados de nuestras propias ideas, menos capaces de pensar de forma independiente y, sobre todo, menos capaces de aprender. ¿La inteligencia artificial nos vuelve estúpidos?

Es una pregunta legítima tras la publicación (preliminar) de un nuevo estudio experimental del Media Lab del Instituto Tecnológico de Massachusetts (MIT) sobre los efectos de los «grandes modelos lingüísticos».

El título del artículo habla por sí solo: ‘Tu cerebro y ChatGPT: acumulación de deuda cognitiva al utilizar un asistente de inteligencia artificial para tareas de escritura’. Al frente del mismo está Natalia Kosmyna, investigadora doctora en informática que trabaja en la interacción entre los ordenadores y el cerebro humano. El modelo de investigación de Kosmyna y sus compañeros, entre los que se encuentran varios neurocientíficos y estudiosos del lenguaje, fue totalmente experimental.

Kosmyna creó tres grupos a partir de una muestra de 54 voluntarios, encargando a cada uno de los miembros que escribiera tres textos breves durante tres sesiones sucesivas sobre temas predefinidos. El primer grupo sólo podía escribir basándose en sus propios recursos mentales, sin acceso ni a Internet ni a una pantalla. El segundo grupo tenía acceso a Google para escribir el texto, y el tercer grupo, en cambio, tenía acceso a la inteligencia artificial generativa, concretamente a ChatGPT. Los cerebros de los participantes de los tres grupos se analizaron conectándolos a electrodos para realizarles una electroencefalografía mientras realizaban la tarea requerida.

Los resultados son sorprendentes, tanto en los efectos inmediatos como en los posteriores del experimento sobre el comportamiento y las capacidades mentales de las personas sometidas a la prueba.

En primer lugar, en el mismo proceso de escritura, los miembros de los tres grupos mostraron una activación muy diferente de sus mentes. En comparación con el nivel del grupo que escribió sin apoyo digital, el grupo con acceso únicamente al motor de búsqueda mostró entre un 34% y un 48% menos de conectividad cerebral; el grupo con acceso a ChatGPT mostró un 55% menos de conectividad cerebral. En esencia, cuanto más consistente es el apoyo, menor es la amplitud de la actividad cerebral.

La calidad del trabajo también cambia

El grupo que no tuvo acceso a tecnología de ningún tipo para escribir muestra una activación de las áreas del cerebro relacionadas con la ideación creativa, con la integración de significados entre ellas y con el autocontrol.

Sin embargo, los que utilizan Google trabajan principalmente el córtex occipital y visual: las áreas que se encargan de asimilar a través de la vista la información obtenida en la pantalla y de recopilarla después. Por último, quienes utilizan ChatGPT activan principalmente las áreas destinadas a funciones casi automáticas y dentro de un andamiaje externo.

Las obras producidas eran muy variadas y diferentes entre sí en el caso del grupo ‘cerebro’ pero extremadamente homogéneas y similares entre sí en el caso del grupo que utilizó inteligencia artificial. En esencia, apoyarse en la IA genera conformidad de pensamiento y mensajes.

Sin embargo, aquí se produjo otra sorpresa: en el 83% de los casos, los que habían trabajado con ChatGPT tuvieron dificultades para citar frases de sus propios textos pocos minutos después de entregarlos; como si los que habían escrito con ChatGPT no hubieran desarrollado ningún sentido de propiedad con respecto al contenido de su trabajo y toda su atención se hubiera centrado únicamente en cómo reproducir pasivamente la información generada externamente.

En cambio, casi todos los que habían trabajado solos eran capaces de citar frases de los textos que acababan de escribir casi con exactitud, mostrando mucha más atención al contenido y al significado del trabajo que habían realizado (no sólo a la forma).

Los conceptos no se asimilan

En esencia, el uso de inteligencia artificial convirtió a los sujetos del estudio en meros ensambladores de conceptos que no son asimilados por sus propios autores.

A continuación, los textos se examinaron como pequeñas redacciones escolares. Los evaluadores basados en la inteligencia artificial otorgaron notas más altas que los textos escritos con la misma inteligencia artificial. En cambio, los evaluadores humanos, los profesores, reconocieron inmediatamente qué textos estaban escritos con inteligencia artificial y los puntuaron más bajo que los demás.

Pero lo que ocurrió a continuación da aún más que pensar. De hecho, hubo una cuarta sesión de la prueba en la que se invirtieron las partes. Al grupo que siempre había utilizado la inteligencia artificial se le pidió que compusiera un texto de tema fijo sin ningún tipo de apoyo digital; por el contrario, a los que hasta entonces habían escrito sin apoyo se les permitió utilizar ChatGPT.

El estudio concluye: «Cuando los participantes (en la prueba, ed.) reproducen las sugerencias (de la inteligencia artificial, ed.) sin evaluar su exactitud o pertinencia, no sólo renuncian a apropiarse de las ideas expresadas, sino que corren el riesgo de interiorizar perspectivas superficiales o distorsionadas».

En otras palabras, se convierten en individuos más manipulables por todo tipo de propaganda o intereses.

Las implicaciones para la democracia y para las escuelas o universidades no podrían ser mayores: una sociedad de personas libres y capaces de desarrollar ideas y juicio autónomo utiliza, en efecto, la inteligencia artificial; pero sólo después de haber entrenado muy bien -y durante mucho tiempo- a la natural.

Fuente: El Mundo